开源

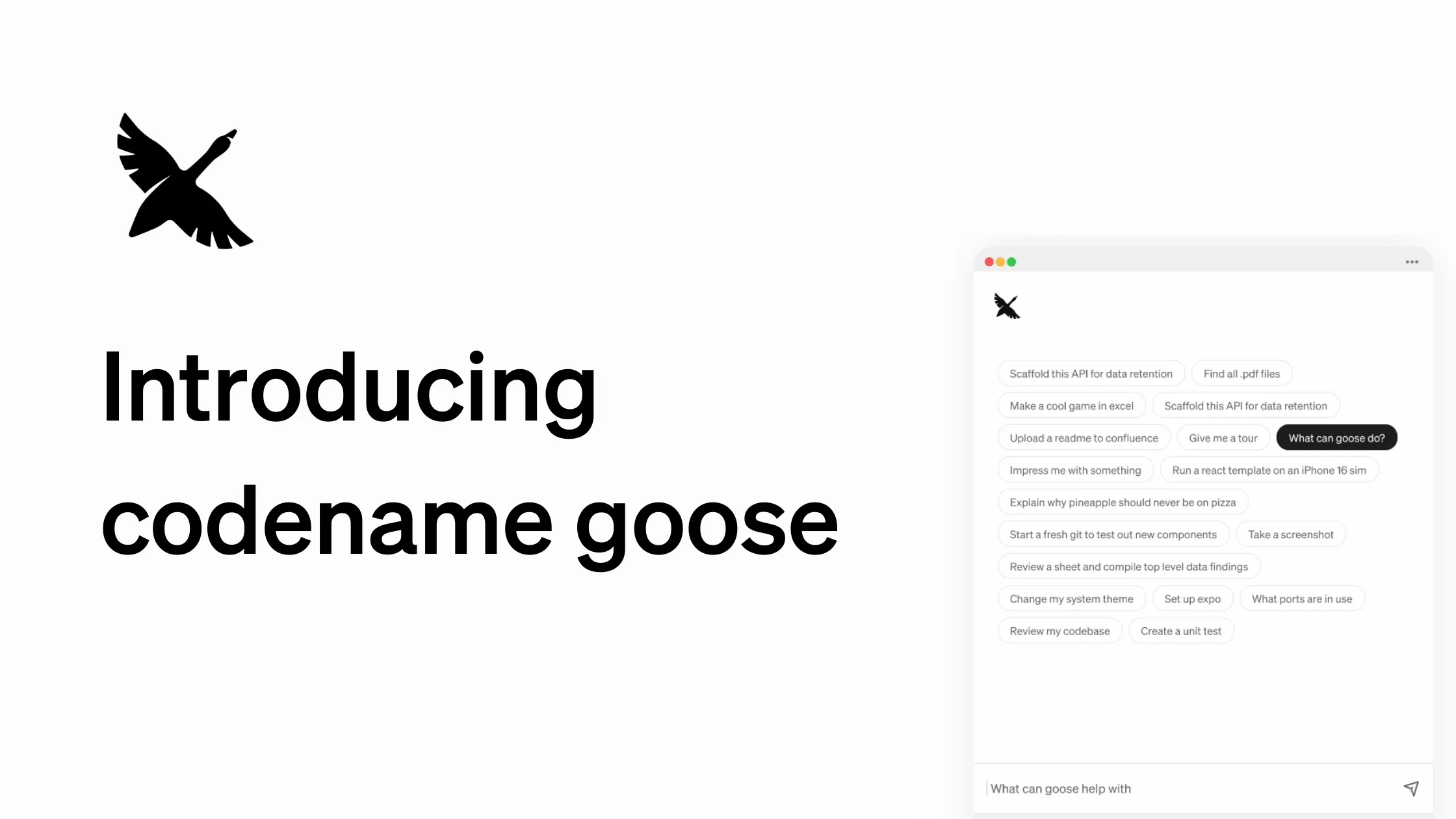

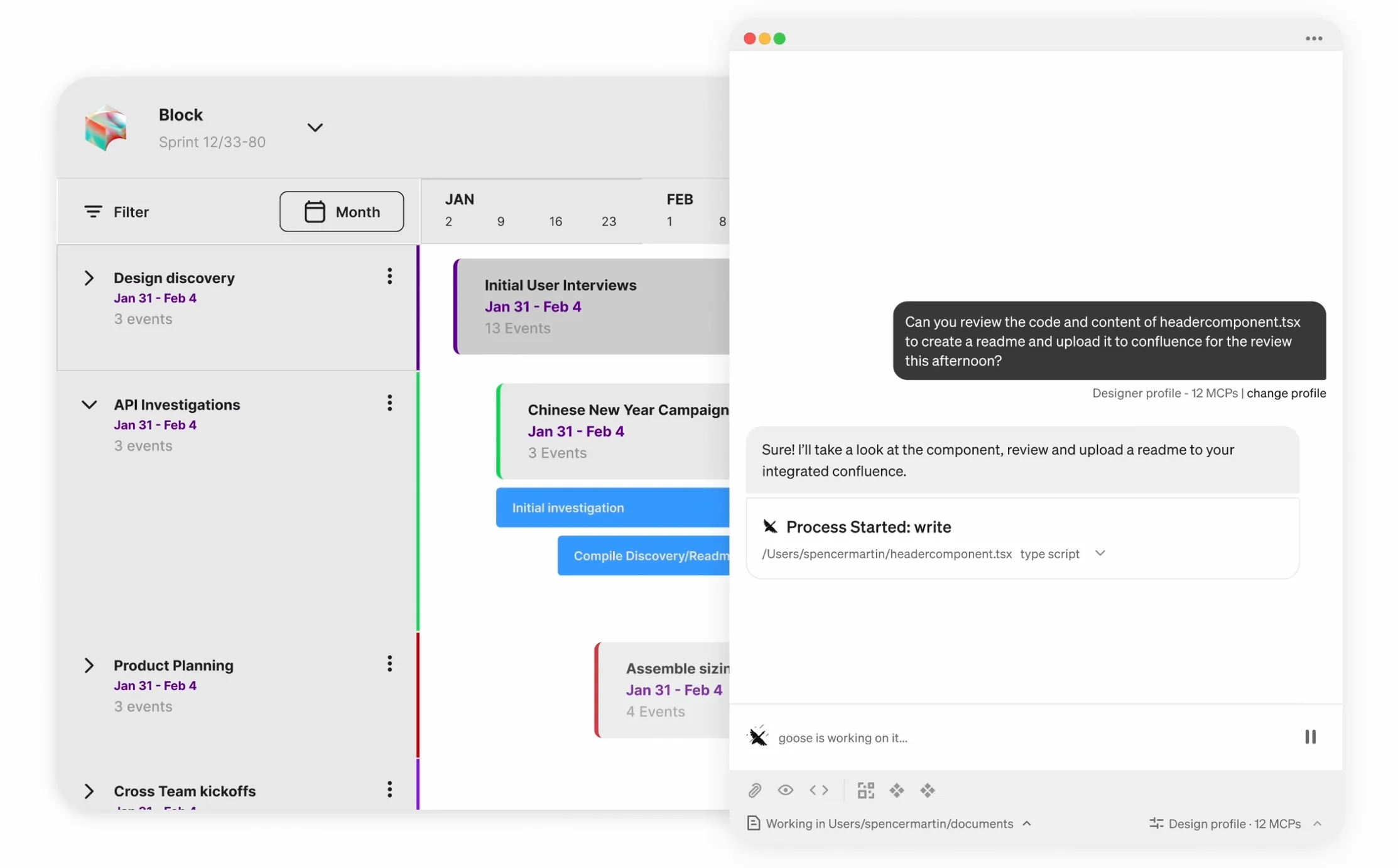

FancyVideo

FancyVideo是一款由360公司与中山大学合作开发的AI文生视频模型,采用创新的跨帧文本引导模块(CTGM)。它能够根据文本描述生成连贯且动态丰富的视频内容,支持高分辨率视频输出,并保持时间上的连贯性。作为开源项目,FancyVideo提供了详尽的文档和代码库,便于研究者和开发者深入研究和应用。主要功能包括文本到视频生成、跨帧文本引导、时间信息注入及时间亲和度细化等。